这是第10期周刊,每

周五发布!(本周在周日发布)

OpenAI 推出嵌入式 Realtime API SDK

OpenAI 最近开源了针对嵌入式平台的 Realtime API SDK,使得开发者能够轻松将 Realtime API 集成到 ESP32S3 上。

至此,OpenAI 已经在嵌入式、Web、移动设备和桌面端实现了全覆盖。

这项技术可以集成在小的开发板上更加智能的语音助手。

例如:利用这个开发版上开发一个实时智能交互的人脑艺术装置的大脑语音系统(Open AI + 语音 + 艺术装置)以及一些智能设备的集成。

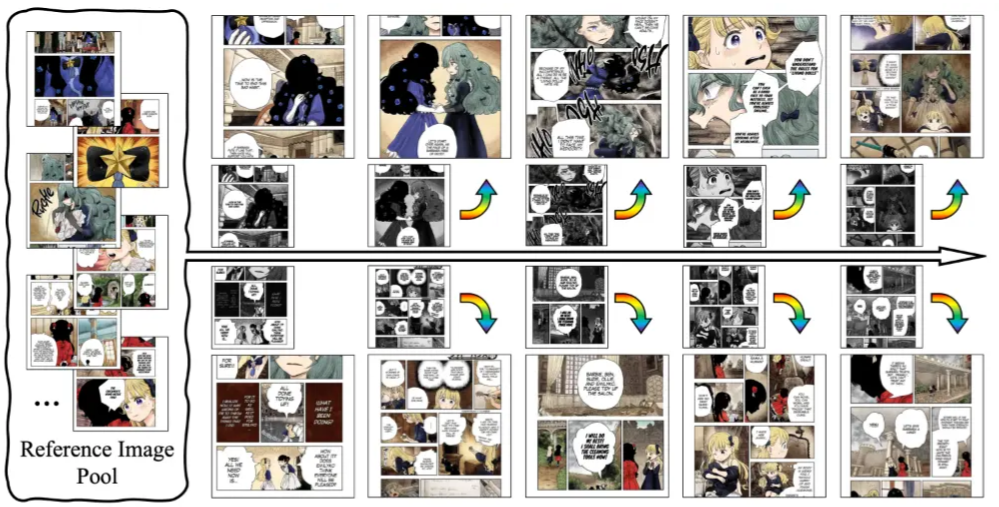

腾讯 ARC 开源 ColorFlow:精准上色模型

ColorFlow 是腾讯 ARC 开源的一款上色模型,用户只需上传多张参考图,即可为灰度图或线稿完成上色。

这个模型最大的亮点在于能够保持角色颜色的一致性,生成的颜色更接近参考图像。此外,还有一个在线演示,大家可以去体验一下 在线演示,看看效果如何。

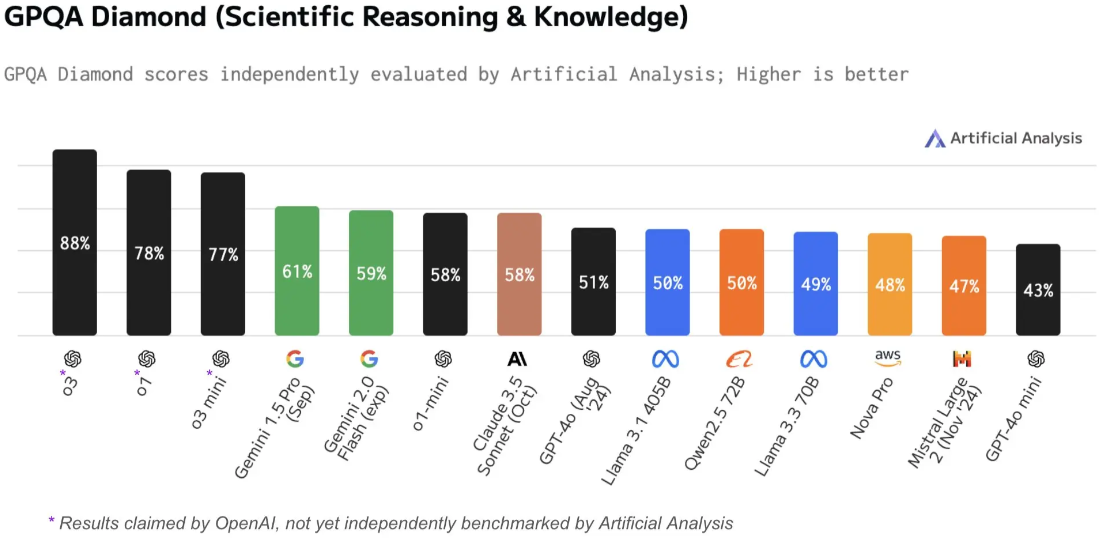

OpenAI 发布会最后一天 :o3 推理能力质的飞跃

OpenAI 在 12 Days 活动的最后一天宣布了下一代推理模型 o3,该模型在数学和推理能力方面有显著提升,在各项基准测试中均显著超越 o1。

不过,这个模型还没有上线,官方预计在 2025 年初正式上线。

价格方面,在 ARC-AGI 基准测试中,目前公开的低计算量模式下,完成每个任务的成本为 20 美元,高计算量模式下的成本尚未公布,计算量大约是低计算的 172 倍,可能高达数千美元。

Google Gemini 的 Deep Research

为了帮你做一个研究任务,gemini 阅读了 151 个英文网站,帮你写了一份研究报告,还附带16 个英文参考文献

单独在“主题研究”这件事上做到极致,就是一个能帮用户实实在在提高生产力、节约时间的神器!

以视频(录屏,无声音)中案例来讲,Deep Research 帮我阅读了151 个网站,然后生成了详细的报告。

报告可以直接在 google docs 中打开,每个要点都附带了参考文献。这些都是英文的、真实的、高质量的参考文献。想象一下,读完这些参考文献,你得花多少小时?deep research 这样的工具,能帮你节约多少时间?

【小技巧】中文写 prompt,最后加一句:research in english, respond in chinese.(万能 prompt,AI 搜索场景比用,适合所有 LLM。加了这一句,会在 google 上搜索英文高质量材料,然后综合加工后生成中文报告。一级棒!)

AI短片

这部短片《The Heist》是完全 AI 生成的,片中所有画面都是用Google最新的视频生成模型Veo 2制作的,导演 Jason Zada。

导演透露,为了打造这部作品,他进行了数千次的生成尝试,然后再剪辑而成。

另外音效、配乐是导演自己生成的。

QVQ-72B-Preview:开源多模态推理模型

QVQ-72B-Preview 是阿里通义团队基于 Qwen2-VL-72B 构建的开源多模态推理模型,专注于增强视觉推理能力,目前还是实验性研究模型。

该模型在 MMMU 基准测试中取得了 70.3 的分数,显著超越了 Qwen2-VL-72B-Instruct。在剩下的三个专注于数学和科学问题的基准测试中,有效缩小了与 o1 模型之间的差距。

你们可以在线演示玩一下在线演示。

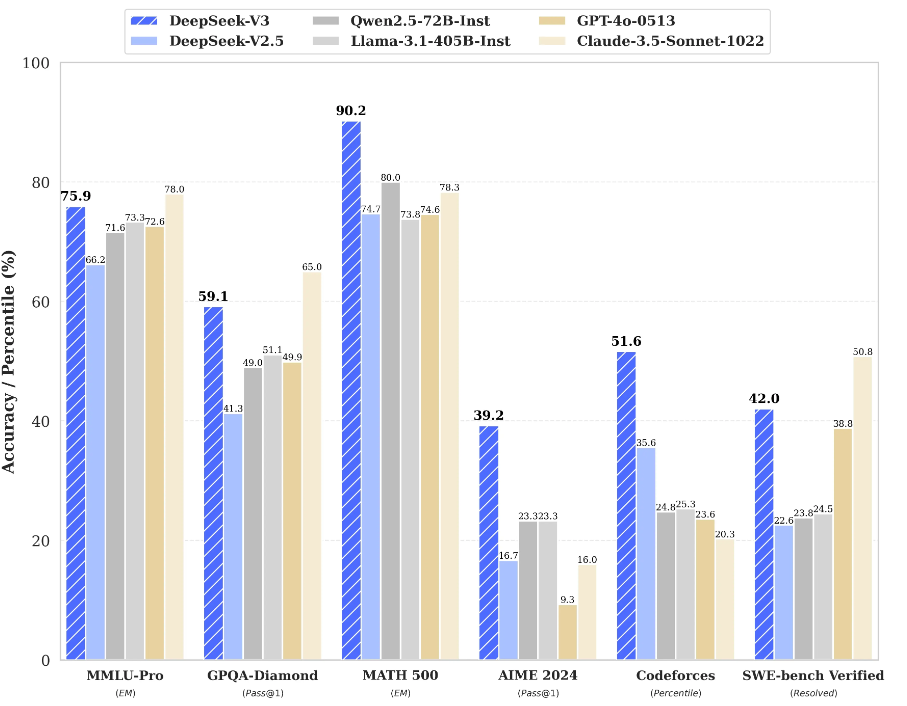

DeepSeek-V3 发布:性能领先,速度飞跃,API 定价调整

DeepSeek-V3 首个版本正式上线并同步开源。该模型在多项评测中超越了 Qwen2.5-72B 和 Llama-3.1-405B 等其他开源模型,并在性能上与世界顶尖的闭源模型 GPT-4o 相媲美。之前令人诟病的吐字速度从 20 TPS 大幅提高至 60 TPS,比 V2.5 提升了 3 倍。

不过,此次更新也在预期内调整了 API 服务定价,每百万输入 tokens 2 元(涨价 2 倍),每百万输出 tokens 8 元(涨价 4 倍)。官方为了过渡此次涨价,还特意提供了 45 天的优惠价格体验期,至 2025 年 2 月 8 日起 API 价格将恢复至新版本的价格,也算是良心。

波士顿动力电动Atlas机器人

扮成圣诞老人

进行后空翻 进行了慢放,穿个衣服还真是分辨不出来

工具分享

AI 调色盘生成器

该网站可以根据输入的关键词,生成对应的色彩组合。